IntraFind stellt in einem aktuellen Branchenbeitrag die zentralen Hebel zur Wiederherstellung des Nutzervertrauens in der Künstliche Intelligenz-Nutzung vor und verknüpft technische Produkte mit Governance-Ansprüchen. Der Text skizziert, wie Enterprise-Search, RAG-basierte Chatbots und eine Open-Source-Plattform dazu beitragen sollen, Datensicherheit, Transparenz und Ethik als Entscheidungsfaktoren in Unternehmen zu verankern. Dieser Bericht fasst die Kernpunkte zusammen und ordnet sie in die Praxis ein.

Agentic AI und nachvollziehbare Antworten: iAssistant als Beispiel für Transparenz

Das Münchner Unternehmen IntraFind positioniert seinen iAssistant als RAG-gestützten GenAI-Chatbot, der Suchergebnisse in kontextuelle, quellennachprüfbare Antworten verwandelt. Im Fokus steht dabei die Forderung nach Auditierbarkeit und Erklärbarkeit, wie sie etwa durch den EU AI Act an Bedeutung gewinnt.

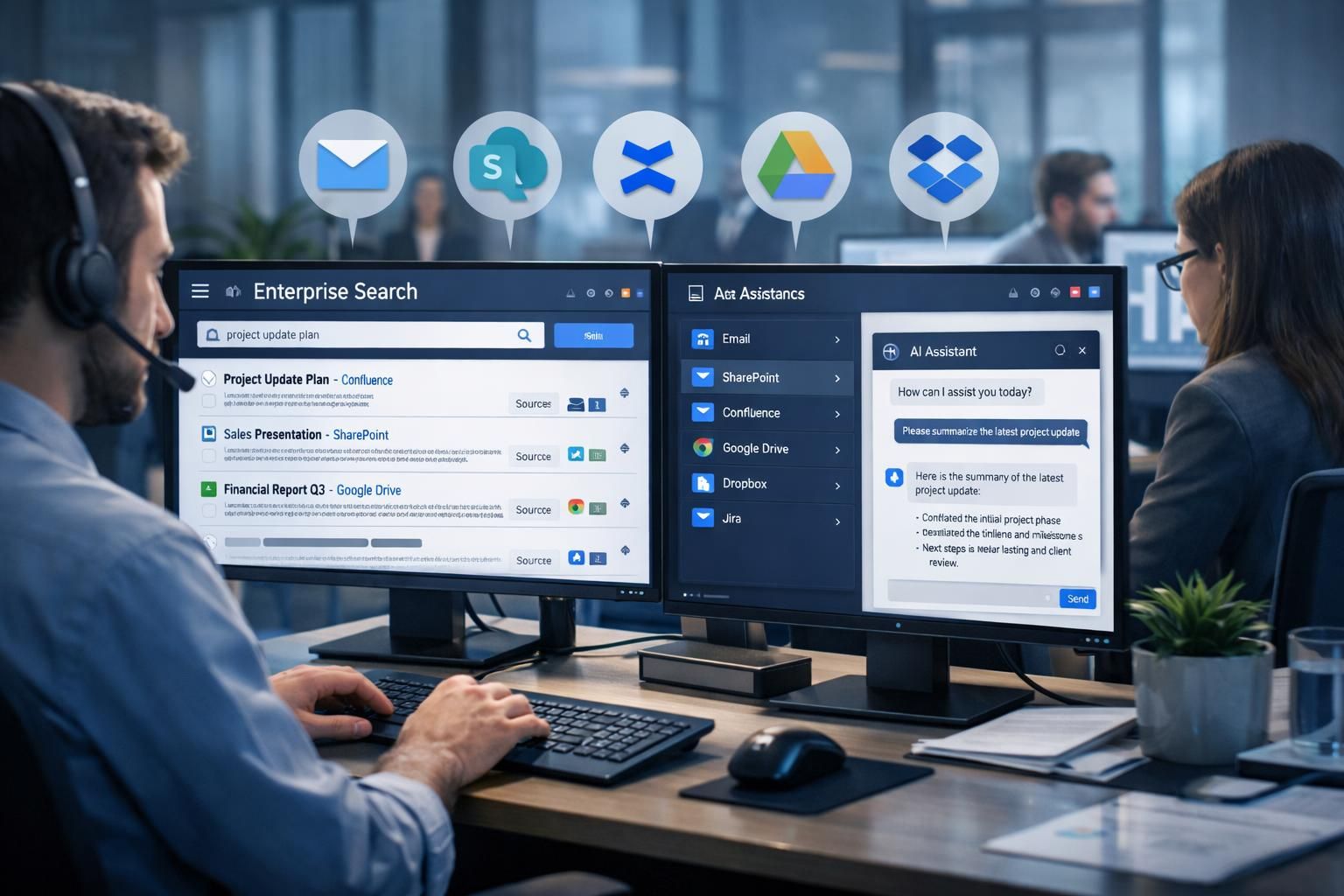

Technisch basiert der Ansatz auf einer Kombination aus Enterprise Search und Retrieval-Mechanismen, sodass Antworten nur auf Daten zurückgreifen, für die Nutzer berechtigt sind. Das reduziert das Risiko von Fehlinformationen und stärkt die Vertrauensbildung gegenüber generativen Systemen.

Praxisbeispiel: Behörden und Konzerne, die IntraFind in Referenzen nennen, profitieren laut Anbieter von transparenter Quellenangabe und schneller Nachvollziehbarkeit in Entscheidungsprozessen. Insight: Wer Erklärbarkeit konsequent einbaut, legt einen Hebel für Regulierungskonformität und Technologieakzeptanz frei.

Enterprise Search als technischer Hebel für Datensicherheit und Wissenstransfer

Als zentrales Element der KI-Trends 2026 beschreibt IntraFind den iFinder als Indexierungsschicht, die heterogene Bestände — von E-Akten über E-Mails bis hin zu Fachportalen — vereinheitlicht. Solche Lösungen adressieren die wachsende Komplexität verteilter Datenlandschaften und die Herausforderung, Expertenwissen langfristig zu sichern.

Wesentlich ist die Verzahnung von Such- und KI-Layer: Nur wenn Treffer rechtegeprüft und kontextualisiert geliefert werden, lassen sich RAG-Modelle verantwortbar betreiben. Unternehmen wie BMW oder Behörden wie das Bundesministerium für Arbeit und Soziales, die in Referenzen genannt werden, zeigen den Praxisbezug dieser Forderung.

Auswirkung: Eine robuste Enterprise-Search-Infrastruktur wird zum Hebel für Technologieakzeptanz und operativen Nutzen, weil sie messbaren ROI, Compliance und reduzierte Fehlerraten in Recherchen ermöglicht. Das ist ein klarer Entscheidungsfaktor für CIOs.

iHub, Ethik und die organisatorischen Hebel für nachhaltige Implementierung

Mit dem iHub bietet IntraFind eine OpenSource-basierte Plattform für generative KI-Anwendungen, die On-Premises oder DSGVO-konform in der Cloud betrieben werden kann. Die Micro-App-Architektur soll Anwendern ohne tiefes Prompt-Wissen produktive Werkzeuge bereitstellen.

Die strategische Herausforderung bleibt jedoch über Technologie hinaus: Unternehmen müssen Wissensmanagement, Datenqualität und Kontrollprozesse priorisieren, um Datensicherheit und Ethik zu gewährleisten. IntraFind ergänzt Produkte mit Professional Services für Use-Case-Definition und Rollout-Unterstützung.

Konsequenz: Der entscheidende Hebel für erfolgreiche KI-Einführung liegt weniger in einzelnen Modellen als in der Kombination aus technischer Basis, klaren Governance-Richtlinien und pragmatischen Betriebsmodellen. Insight: Wer diese Elemente zusammenbringt, erhöht die Wahrscheinlichkeit, dass Nutzer KI-Lösungen akzeptieren und reale Produktivitätseffekte entstehen.

Kurz zusammengefasst: Die Debatte um Nutzervertrauen in der Künstliche Intelligenz verschiebt sich 2026 von Technologiefragen hin zu Entscheidungsfaktoren wie Transparenz, Compliance und operationaler Integration. Anbieter wie IntraFind zeigen, dass kombinierte Plattformansätze — Enterprise Search, erklärbare RAG‑Services und sichere Deployments — zu den entscheidenden Hebeln für nachhaltige Vertrauensbildung gehören.